Un grupo de prominentes investigadores de la Universidad de Nueva York hizo un llamado para prohibir el uso de tecnología de análisis automatizado de expresiones faciales, especialmente, en procesos de contratación y otra clase de decisiones empresariales.

Las críticas se centran en el uso de software para el análisis durante entrevistas de trabajo, como por ejemplo, el de la compañía HireVue, utilizado por compañías como Hilton y Unilever, cuya inteligencia artificial analiza movimientos faciales, tono de voz y patrones de discurso en entrevistas a distancia, informó Reuters.

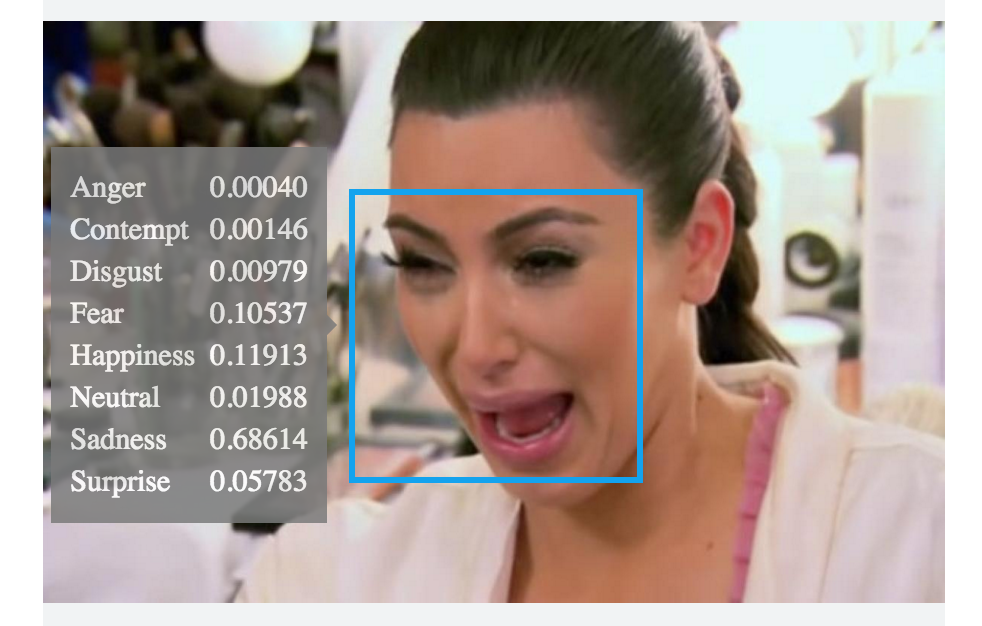

De acuerdo con los especialistas, del Instituto AI Now, no existen fundamentos científicos que justifiquen el uso de tecnología de “reconocimiento de emociones” y aún hay tiempo para evitar que su adopción sea masiva, ya que esta es una de las tantas formas en que se utiliza este tipo de software sin rendición de cuentas y que favorece a grupos típicamente privilegiados.

En su cuarto reporte anual, el instituto cita análisis de estudios sobre cómo se interpretan las expresiones faciales y cómo estas percepciones resultan poco confiables por una diversidad de razones, como el hecho de que las personas comunican sus emociones de forma sustancialmente diferentes dependiendo incluso de su cultura.

Mientras tanto, empresas como Microsoft están publicitando su habilidad para clasificar emociones usando software, Amazon también ofrece análisis de expresiones a través de su software Rekognition, el cual ha sido duramente criticado por otros grupos de investigadores debido a su sesgo contra personas de tez oscura y mujeres.

Dos fundadoras de AI Now, Kate Crawford y Meredith Whittaker aseguraron previo a lanzar el reporte que a pesar del amplio consenso sobre los principios éticos, los usos dañinos de la inteligencia artificial se están multiplicando debido a que no existen consecuencias por violarlos.

A finales de octubre de 2019, más de 80 organizaciones que defienden derechos digitales alrededor del mundo, pidieron declarar una moratoria al uso de la tecnología de reconocimiento facial que permite la vigilancia masiva y posibilita el control político.