Un grupo de 25 investigadores sobre inteligencia artificial dirigió una carta a la compañía Amazon para pedirle que deje de vender tecnología de reconocimiento facial a agencias de seguridad e impartición de justicia debido a su sesgo contra personas de color y mujeres.

De acuerdo con The New York Times, la carta fue enviada después de que un estudio mostró que el software de reconocimiento facial Rekognition tiene más problemas para identificar rostros de mujeres y de personas de piel oscura: confundió a mujeres por hombres en 19 por ciento de las veces e identificó erróneamente mujeres de piel oscura por hombres en 31 por ciento.

“No hay leyes o estándares requeridos para asegurar que Rekognition es utilizado de una forma que no infrinja libertades civiles”, aseguraron los firmantes. “Hacemos un llamado a Amazon para dejar de vender Rekognition a agencias de seguridad”. Los resultados del estudio fueron rechazados por dos ejecutivos de la empresa en escritos distintos, aunque, de acuerdo con el diario estadounidense, no se acercaron directamente a los investigadores responsables.

La carta fue firmada por los investigadores de Google, Margaret Mitchell, Andrea Frome y Timnit Gebru; la investigadora de Facebook, Georgia Gkioxari; el investigador de DeepMind, William Isaac y Yoshua Bengio, recientemente ganador del Premio Turing, entre otros.

Esta no es la primera vez que se denuncia que este software tiene sesgos con la comunidad afroamericana. En julio de 2018, la Unión Americana por los Derechos Civiles (ACLU) realizó un experimento con Rekognition; el software identificó falsamente a 28 miembros del Congreso estadounidense como personas con algún antecedente delictivo.

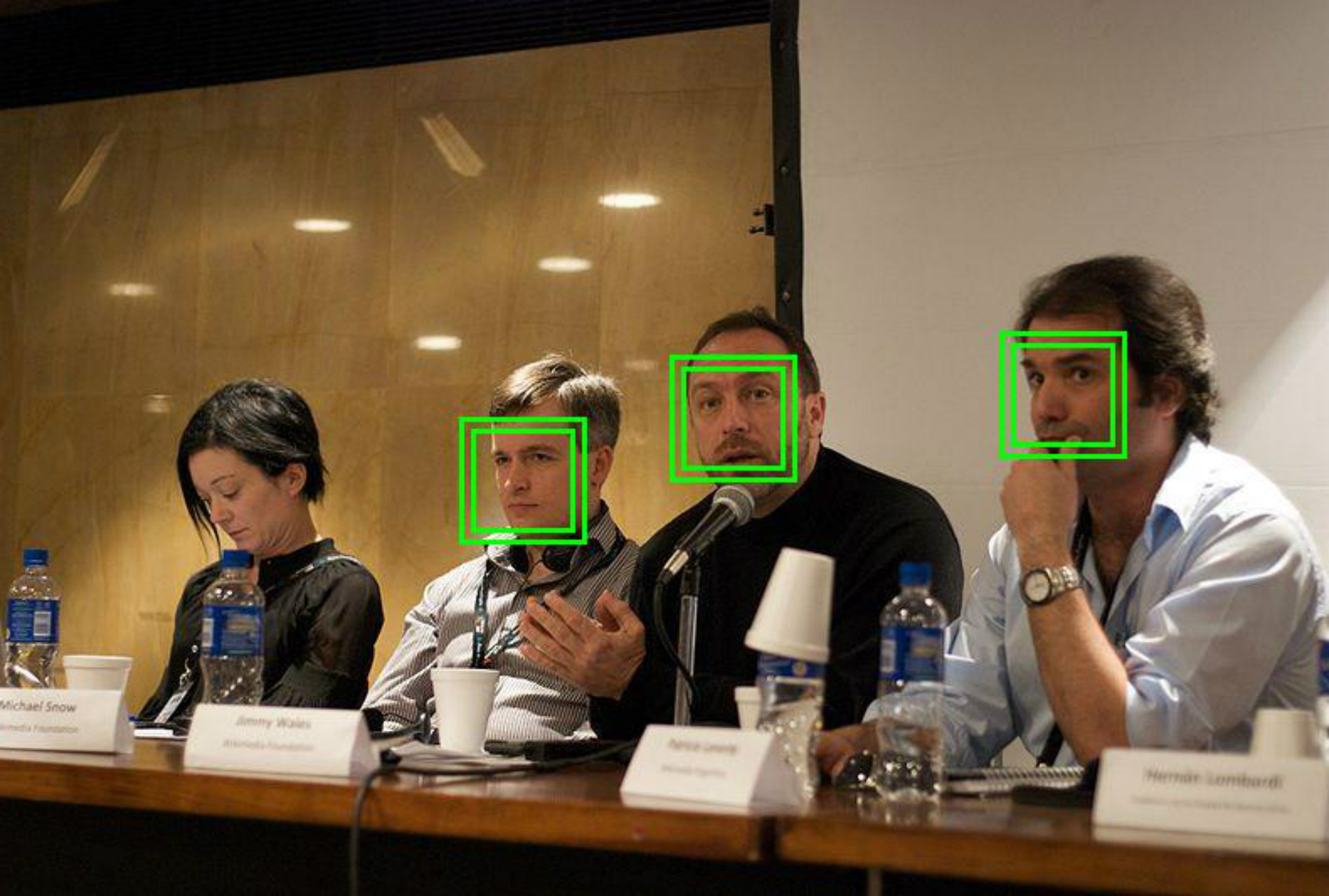

Imagen de Sylenius (CC BY 2.0)