Un conjunto internacional de organizaciones que defienden derechos digitales —entre ellas, R3D: Red en Defensa de los Derechos DIgitales— alertamos a los integrantes del Parlamento Europeo acerca de los peligros y riesgos que implica la implementación de herramientas de filtrado automatizado para combatir la difusión de contenidos “terroristas”.

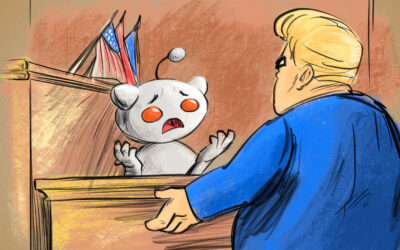

La propuesta de Regulación para Prevenir la Diseminación de Contenido Terrorista en Línea, presentada en 2018, obligaría a las plataformas de Internet a utilizar “medidas proactivas para detectar contenido terrorista, como los mecanismos de filtrado automatizado, basados en inteligencia artificial, y una gigantesca base de datos para identificar imágenes y videos que se han previamente identificado como material extremista “terrorista”.

Además, esta base de datos habría sido desarrollada por Facebook, YouTube, Microsoft y Twitter; fue anunciada en 2016, y se compone de cerca de 80 mil imágenes y videos que fueron identificadas bajo criterios privados y opacos.

Sobre las herramientas de filtrado, las organizaciones señalamos la existencia de suficiente evidencia sobre las fallas de estos sistemas, ya que fomentan la inequidad en el uso de Internet de los usuarios (dependiendo de su trasfondo étnico, religioso, lingüístico y geográfico) por lo que afecta desproporcionada a comunidades marginalizadas; además de representar un peligro para el ejercicio de derechos como la privacidad y la protección de datos.

Finalmente, las organizaciones consideramos que las herramientas propuestas por la Unión Europea tendrán efectos negativos para usuarios fuera del territorio europeo y advierten que el uso de medidas de filtración y remoción de contenidos abre la puerta a que gobiernos autoritarios (o con inclinaciones autoritarias) también las apliquen en sus propias “legislaciones antiterroristas”.